Hermes-Gateways pollen non-stop. Unsere Plattform bleibt stabil, damit Telegram, Discord und der ganze Rest nicht als Zombies enden.

SQLite mit FTS5-Search bleibt schnell, auch wenn sich tausende Konversationen und einige hundert automatisch generierte Skills ansammeln.

Beide Adressen sind standardmäßig dabei, damit Webhooks, ACP-Server und Gateway-Verbindungen ab dem ersten Boot sauber routen.

Hermes shippt schnell. Mach vor dem hermes update einen Snapshot und rolle in Minuten zurück, wenn ein Release dir etwas verstellt.

Lass Gateways als systemd-Services laufen, installier dir MCP-Server, zeig auf ein lokales Ollama. An deine Config geht niemand ran.

Mach SSH, Port 9119 und deine Webhook-Ports aus dem Panel dicht. Der DDoS-Schutz übernimmt deine öffentlich erreichbaren Endpoints.

Hermes Agent ist die Open-Source-AI-Runtime von Nous Research. Du zeigst ihn auf jedes LLM, das du magst (Nous Portal, OpenAI Codex, Anthropic, OpenRouter, GLM, DeepSeek, lokale Ollama-Modelle und 15+ weitere), und der Agent wird mit der Zeit schärfer, weil die Learning Loop wiederkehrende Aufgaben in wiederverwendbare Skills verwandelt, die unter ~/.hermes/skills/ abgelegt werden.

Hermes auf einem VPS hält den Agent rund um die Uhr online. Der Speicher bleibt zwischen Sessions erhalten, geplante Jobs laufen weiter, egal ob du am Schreibtisch sitzt oder schläfst, und du bestimmst, welche Modelle, Gateways oder Integrationen tatsächlich laufen. MIT-Lizenz, null Telemetrie und keine Plattform, die deinem Agent vorschreibt, was er darf.

Helsinki

Helsinki

Lösch die Maschine und fang per Klick vom Dashboard aus neu an. Praktisch, wenn du beim hermes update etwas zerschossen hast oder eine saubere Umgebung brauchst, um ein frisches Setup zu testen, bevor du an deinen Haupt-Agent gehst.

Öffne direkt aus dem Panel eine Konsole, ohne mit SSH-Keys zu jonglieren. Praktisch, um schnell in Gateway-Logs zu schauen, hermes doctor zu starten, wenn sich was komisch anfühlt, oder einen Blick in ~/.hermes/state.db zu werfen, wenn die Session-Suche zickt.

CPU-, Speicher- und Disk-Grafiken sitzen im Dashboard direkt neben den Uptime-Stats. Lohnt einen Blick, wenn der Token-Verbrauch ausschlägt oder state.db unerwartet wächst (passiert gerne, wenn auf den Gateways viel los ist).

Unsere zertifizierten internen Ingenieure stehen rund um die Uhr in mehreren Sprachen zur Verfügung und bieten klare Antworten, schnelle Lösungen sowie leistungsorientierte Beratung, gestützt auf 17 Jahre Erfahrung im Infrastrukturbereich.

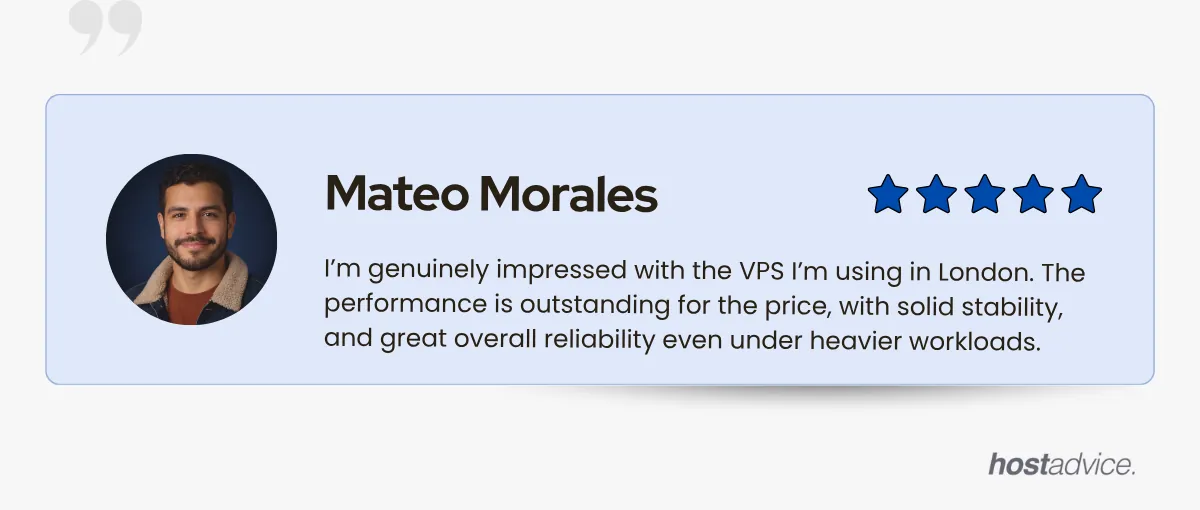

Guter Preis für das, was du bekommst

2025-12-29"Ich nutze ihre Dienste schon eine Weile und es läuft super. Die Performance ist gut und zuverlässig, und der Preis macht das Ganze noch besser. Alles läuft einfach rund, und sie reagieren schnell, wenn man was braucht."

Die Einrichtung war schnell und der...

2025-09-01"Die Einrichtung war schnell und der VPS läuft seitdem reibungslos. Der Kundensupport hat meine Fragen beantwortet, ohne die Sache kompliziert zu machen, was mir ehrlich gesagt gut gefallen hat."

Klasse Team und Unternehmen

2025-03-01"Klasse Team und Unternehmen. Während sie ihre Dienste in weitere Regionen der Welt ausweiten, bauen sie gleichzeitig ihre Qualität und Effizienz weiter aus."

Guter Service für Webhosting

2025-06-24"Guter Service für Webhosting. Einfache Einrichtung und fairer Preis."

Erstklassiger Anbieter

2026-01-25"Ich bin jetzt schon fast ein Jahr bei Lumadock und ihre Server sind top.

Ich habe bei ihnen ein paar Forex VPS in London und New York und bis jetzt gab es keinerlei Probleme. Die Uptime ist super und der VPS bleibt nicht hängen, wie ich es bei anderen Anbietern erlebt habe.

"

Hermes Agent ist ein Open-Source-AI-Agent von Nous Research. Du hostest ihn selbst auf einem Server, zeigst ihn auf das LLM deiner Wahl (Nous Portal, OpenAI Codex, Anthropic, OpenRouter und viele mehr) und verbindest ihn mit deinen Messaging-Apps, damit er echte Aufgaben übernimmt. Auf Nachrichten mit Kontext antworten, Workflows automatisieren, geplante Cron-Jobs laufen lassen und einen Browser steuern. Die Learning Loop schaut dabei zu, was du tust, und schreibt mit der Zeit neue Skills aus den Mustern, die sie aufschnappt.

Nein, das sind getrennte Projekte. Beide sind Open-Source-AI-Agents, die du selbst hosten kannst, und beide hängen sich mit persistentem Speicher an Messaging-Apps, aber Teams, Codebasen und Skill-Systeme unterscheiden sich. OpenClaw (früher Moltbot) wurde von Peter Steinberger gebaut. Hermes Agent kommt von Nous Research. Manche Leute betreiben am Ende zu unterschiedlichen Zeiten beide, aber sie teilen weder Daten noch Skills direkt miteinander.

Ja. Hermes bringt einen hermes claw migrate-Befehl mit, der deine OpenClaw-Skills, Speicher-Dateien, Messaging-Gateway-Configs und (optional) deine API-Keys übernimmt. Wenn du ihn zuerst mit --dry-run aufrufst, siehst du, was umziehen würde, bevor wirklich etwas passiert. Die meisten Leute machen die Migration auf einer frischen Hermes-Installation und nicht über eine bestehende drüber.

Ein Laptop schläft ein, startet neu und verliert die Netzwerkverbindung, und Hermes spielt seine Stärken vor allem als langlaufender Prozess aus. Messaging-Gateways müssen eingeloggt bleiben, geplante Cron-Jobs brauchen einen Server, der nicht um Mitternacht offline geht, und der Konversationsspeicher wird umso nützlicher, je länger der Agent durchläuft. Ein VPS gibt dir all das zum Preis eines Sandwichs im Monat.

Für leichten Einsatz (ein bis zwei Messaging-Gateways, gelegentliche CLI-Sessions) reicht der 2-GB-Plan locker. Mehrere Subagents, schwere Browser-Automatisierung oder mehrere stark genutzte Messaging-Gateways gleichzeitig fühlen sich auf den 4-GB- oder 8-GB-Plänen entspannter an. Hermes ist für sich genommen sparsam, der Großteil deiner monatlichen Kosten geht meist eher in LLM-API-Calls als in Serverressourcen.

Für den normalen Betrieb nicht. Hermes ruft entspannt aus einem CPU-only-VPS heraus Remote-LLM-APIs auf. Ein GPU-VPS wäre eher etwas für dich, wenn du lokale Modelle mit Ollama oder vLLM betreiben willst, entweder aus Datenschutzgründen oder um API-Rechnungen zu sparen. Sonst decken die Standard-EPYC-Pläne das ab.

Eine Menge. Telegram, Discord, Slack, WhatsApp, Signal, SMS, E-Mail, Matrix, Mattermost und Microsoft Teams laufen alle über das Messaging-Gateway, und Nous baut weiter aus. Speziell WhatsApp nutzt eine Bridge auf Baileys-Basis statt der offiziellen Business API, deshalb empfiehlt Nous, dafür eine eigene Bot-Nummer zu verwenden statt deines privaten Accounts.

In drei Schichten. MEMORY.md und USER.md halten deine langfristigen Fakten und Präferenzen fest und werden in jede Session als stabiler Kontext eingespielt. Skills sind Markdown-Dateien, die Hermes für sich selbst schreibt, sobald er ein wiederkehrendes Muster erfolgreicher Aufgaben erkennt. Der Verlauf der Sessions lebt in einer lokalen SQLite-Datenbank mit FTS5-Volltextsuche, sodass der Agent dir wirklich etwas wiederfindet, wenn du ihn nach etwas von vor zwei Wochen fragst.

Die VPS-Preise siehst du auf den Produktkarten. Die LLM-Kosten schwanken stark, je nachdem, welchen Anbieter du wählst. Ein Setup auf Basis des Free-Tiers von Nous Portal, des kostenlosen Xiaomi MiMo oder Open-Source-Modellen auf OpenRouter kann fast nichts kosten. Ein Setup, das auf GPT-5 oder Claude zeigt und intensiv täglich genutzt wird, kann locker bei 30 bis 50 US-Dollar API-Kosten im Monat landen. Der /usage-Befehl in Hermes zeigt dir deinen Token-Verbrauch in Echtzeit.

Nicht nativ. Hermes unterstützt offiziell Linux, macOS und WSL2 (Windows Subsystem for Linux). Auf einem Windows-Desktop würdest du zuerst WSL2 installieren und Hermes dann darin laufen lassen, was zusätzliche Hürden bringt. Einfacherer Weg: einen Linux-VPS mieten, auf dem das Hermes-Template schon vorinstalliert ist, und WSL komplett umgehen.

LumaDock bietet schnelles und preiswertes VPS, GPU und Dedicated Server Hosting für Entwickler, Unternehmen und Gamer auf Basis von NVMe-Speicher und AMD EPYC.

LumaDock® ist eine eingetragene Marke von LumaDock LTD mit Sitz in London W1S 1HN, Vereinigtes Königreich, und in England und Wales unter der Firmennummer 15844051 eingetragen.

GPU products are in high demand at the moment. Fill the form to get notified as soon as your preferred GPU server is back in stock.

We'll notify you when your preferred server is back in stock.